RAG to z angielskiego Retrieval Augumented Generation czyli generowanie wzbogacone pozyskiwaniem 😉 A chodzi tutaj o to, żeby wydobyć jakąś (Retrieval) wiedzę i dostarczyć ją (Augumented) modelowi generacyjnemu (Generation) aby ten na jej podstawie odpowiedział na pytanie/rozwiązał problem.

Przykładowo znany dobrze ChatGPT ma bardzo szeroką wiedzę, ale na pewno nie wie nic na temat wewnętrznych rozwiązań firmy X, Y, Z (procesy biznesowe, hierarchia pracowników, wewnętrzne dokumentacje itd.). Aby model wiedział o takich rzeczach można albo go ponownie nauczyć, dodając dane dotyczące firmy (co jest dosyć kosztowne). Lub też posłużyć się techniką RAG – dostarczaniem potrzebnych informacji modelowi przed wygenerowaniem przez niego odpowiedzi.

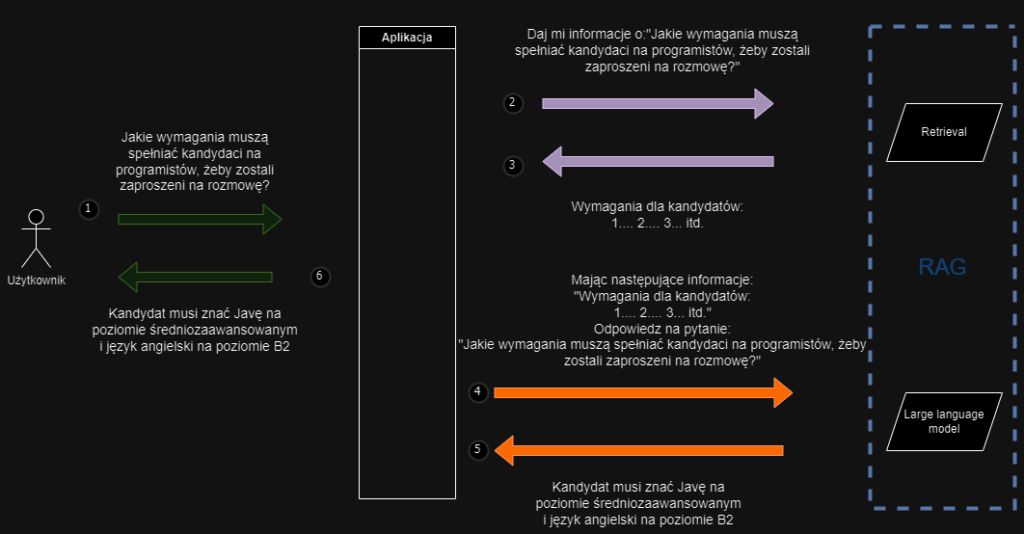

Powyższy diagram pokazuje możliwe zastosowanie techniki RAG do wzbogacenia wiedzy modelu o wiedzę wewnętrzną organizacji:

1. W pierwszym punkcie użytkownik zadaje pytanie dotyczące tematów związanych z organizacją

2. Aplikacja przed przesłaniem pytania do modelu (LLM) prosi system Retrieval o dostarczenie informacji, które mogą się przydać przy udzielaniu odpowiedzi [Retrieval]

3. System Retrieval znajduje dokumenty najbliższe zapytaniu użytkownika i zwraca je do aplikacji [Retrieval]

4. Aplikacja następnie przekazuje pytanie użytkownika do modelu, ale dostarcza także informacje uzyskane z systemu Retrieval [Augumentation]

5. Model posiadając informacje formułuje odpowiedź [Generation]

6. Odpowiedź jest przekazywana do użytkownika